via https://moz.com/blog/integrate-llms-seo-workflow

人工智能和大型语言模型(LLM)已经颠覆了内容营销和SEO,从根本上改变了我们处理工作流程和策略的方式。像 Mike King 这样的专家展示了 101 个用例(https://moz.com/webinars/101-different-ways-seo-for-ai),这清楚地表明潜力是巨大的——而且还在不断增长。

遗憾的是,这种快速采用也引发了一些挑战,尤其是围绕内容原创性和质量方面。如果没有适当的验证,生成式人工智能的输出可能会损害 SEO 声誉和信任,弊大于利。

在本文中,我将分享一个将 LLM 集成到你的 SEO 工作流程中的整体流程。你还将学习如何在实施验证系统的同时,最大限度地发挥生成式人工智能的潜力。

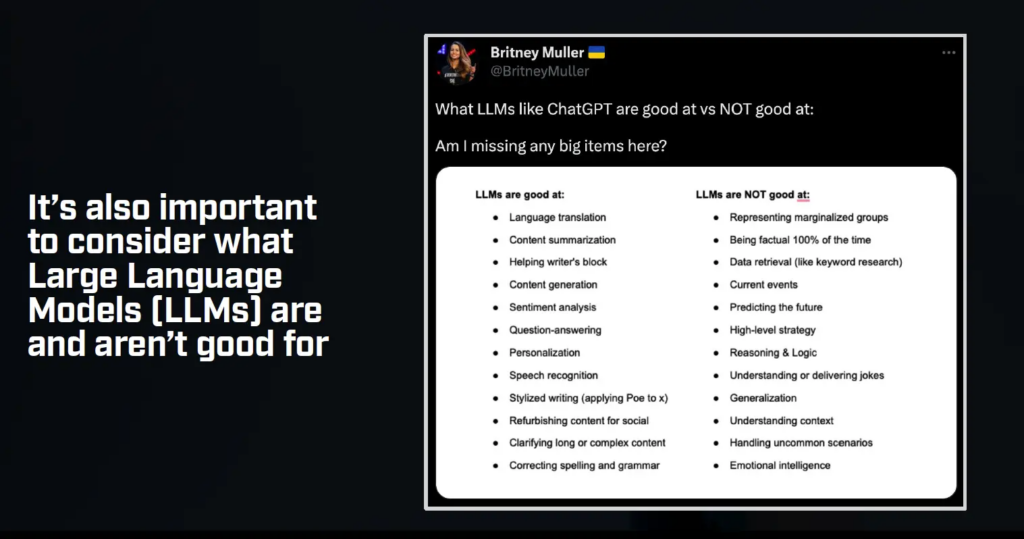

LLM 有其局限性,理解这些局限性非常重要。

虽然 LLM 是强大的工具,但它们并非适用于所有任务。理解它们的局限性是避免失误并确保你负责任地使用这些工具的关键。

正如 Britney Muller 强调的那样,LLM(如 ChatGPT)擅长特定的任务,而另一些任务则不应该用 LLM 自动化。

不应该使用 LLM 的情况:

一些不应该使用 LLM 的情况包括:

- 敏感或关键决策: 不要使用 LLM 来自动化需要高准确性或涉及敏感数据的任务。例如,法律或医疗建议需要人类专业知识,以避免造成重大后果的错误。

- 高风险的创意工作: 当原创性和创造力至关重要时,例如创建独特的品牌活动,LLM 可能会产生通用或缺乏灵感的结果。

- 数据敏感环境: 与 LLM 分享机密或专有信息可能会带来安全风险。始终匿名化敏感数据,并避免泄露关键细节。

将 LLM 集成到你的 SEO 工作流程的三种方式

- 提示(Prompting)

要最大限度地利用 LLM,首先要提出正确的问题。准确的提示确保你收到清晰、相关且可操作的结果,从而节省时间并减少多次迭代的需求。

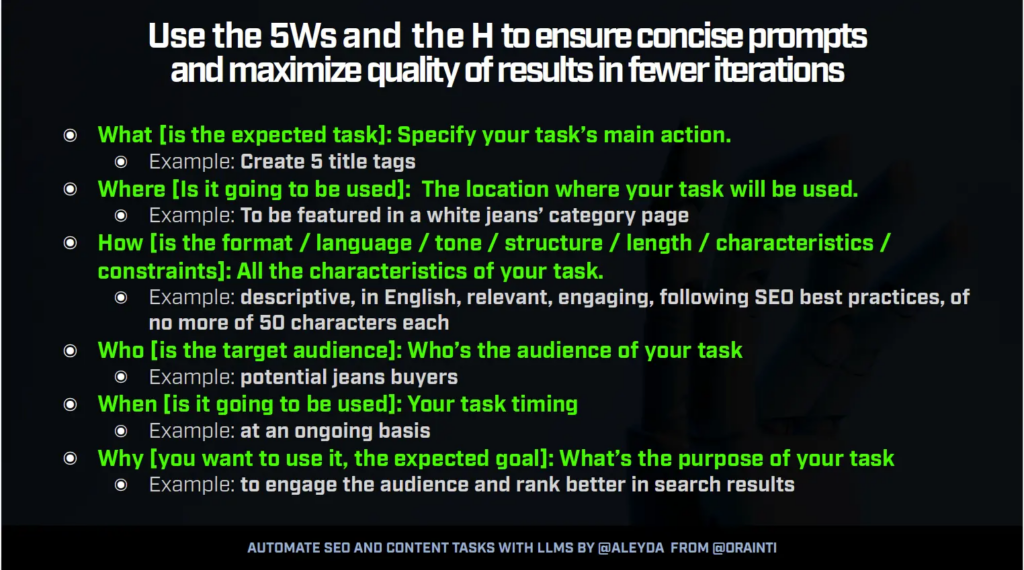

一种有效的方法是 5W1H 框架,它可以确保你的提示详细且重点突出:

- What(什么): 预期任务是什么?明确主要行动——例如,“生成五个优化的标题标签”。

- Where(哪里): 将在哪里使用?定义上下文或位置——例如,“在白色牛仔裤类别页面上展示”。

- Who(谁): 目标受众是谁?确定目标受众——例如,“潜在的牛仔裤买家”。

- When(何时): 何时使用?提及时间或频率——例如,“持续进行”。

- Why(为什么): 你想使用它做什么?说明目的或目标——例如,“为了吸引受众并在搜索结果中获得更好的排名”。

- How(如何): 你将如何格式化它?提供诸如语气、语言、结构或约束等详细信息——例如,“描述性,英语,相关,引人入胜,遵循 SEO 最佳实践,且每个不超过 50 个字符”。

与其问“给我一些标题标签的想法”,不如试试这个:

“为白色牛仔裤类别页面生成五个对 SEO 友好的标题标签。受众是潜在的牛仔裤买家,语气应该是引人入胜和描述性的。每个标题都应少于 50 个字符,并针对搜索结果进行优化。”

此方法可确保你的提示清晰而精确,使 LLM 能够第一次就提供更接近你需要的结果。

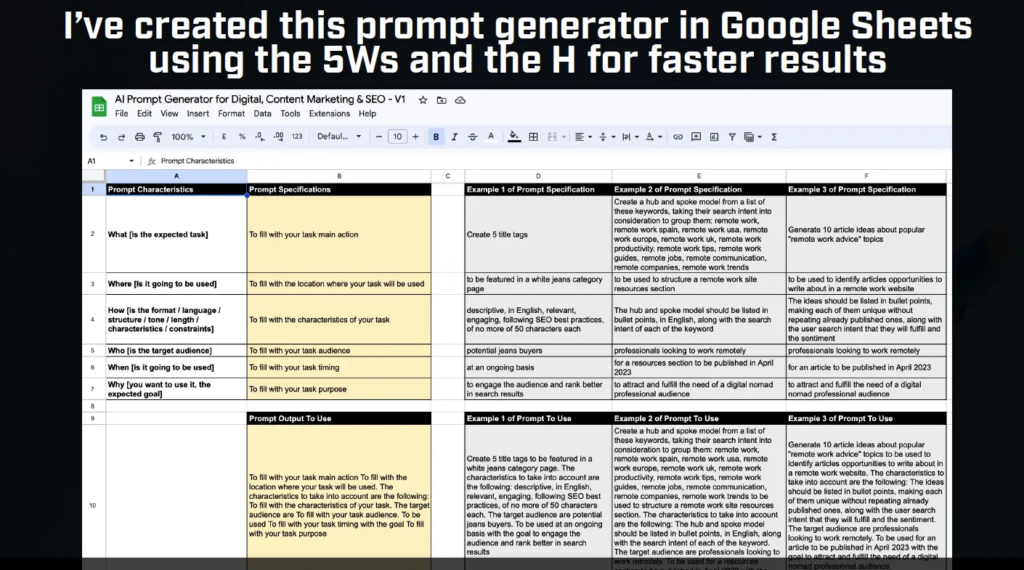

- 创建提示库

创建量身定制的提示库可以确保一致性,节省时间,并减少重复性任务的猜测。

以下是如何有效地构建和使用提示库的方法:

创建可重复使用的提示:

- 识别重复性任务,例如生成标题标签、元描述或内容大纲。

- 开发能够持续提供可靠结果的提示,使用像 5W1H 这样的框架来保持清晰度。

组织提示以便快速访问:

- 按任务类型(例如,内容创作、技术 SEO、竞品分析)对提示进行分类。

- 使用 Google Sheets 或 Notion 等工具存储、标记和检索提示。随意复制我的 SEO 提示生成器。

在团队中标准化工作流程:

- 与你的团队共享提示库,以确保输出一致,尤其是在协作项目中。

- 鼓励团队成员根据其特定需求改进和扩展库。

例如,与其为每个元描述起草新的提示,你的库可能包含一个可重复使用的模板:

“为[页面/主题]撰写元描述。使用引人入胜的语气,包含关键词[关键词],并保持在 160 个字符以内。”

- 将 SEO 工具连接到 OpenAI

SEO 工具越来越多地在其平台中嵌入 ChatGPT 功能。这种集成允许你生成见解和建议,而无需离开你现有的工作流程。

以下是一些杰出的人工智能 SEO 工具及其具体应用:

- SEOTesting.com

SEOTesting.com 在其平台内集成了 ChatGPT,以简化内容优化和报告任务。这种集成允许进行可定制的实时建议。

SEOTesting.com 的主要用例:

- 识别缺少或弱元数据的表现不佳的页面。

- 使用见解来改进元数据,例如添加缺失的关键词或重新措辞标题标签,以更好地与关键词意图保持一致。

- Horseman SEO crawler

Horseman SEO crawler 将技术审核与内容建议相结合,解决了元数据优化和关键词提取问题。

Horseman SEO crawler 的主要用例:

- 元描述生成: 自动为缺少元数据的页面创建描述,确保它们与最相关的关键词保持一致。

- 关键词提取: 分析页面内容以识别排名靠前或缺失的关键词,并建议将其集成到元数据中。

- 技术 SEO 见解: 使用无需编码的人工智能界面来抓取并获得可操作的建议,以解决在抓取过程中发现的技术 SEO 问题。

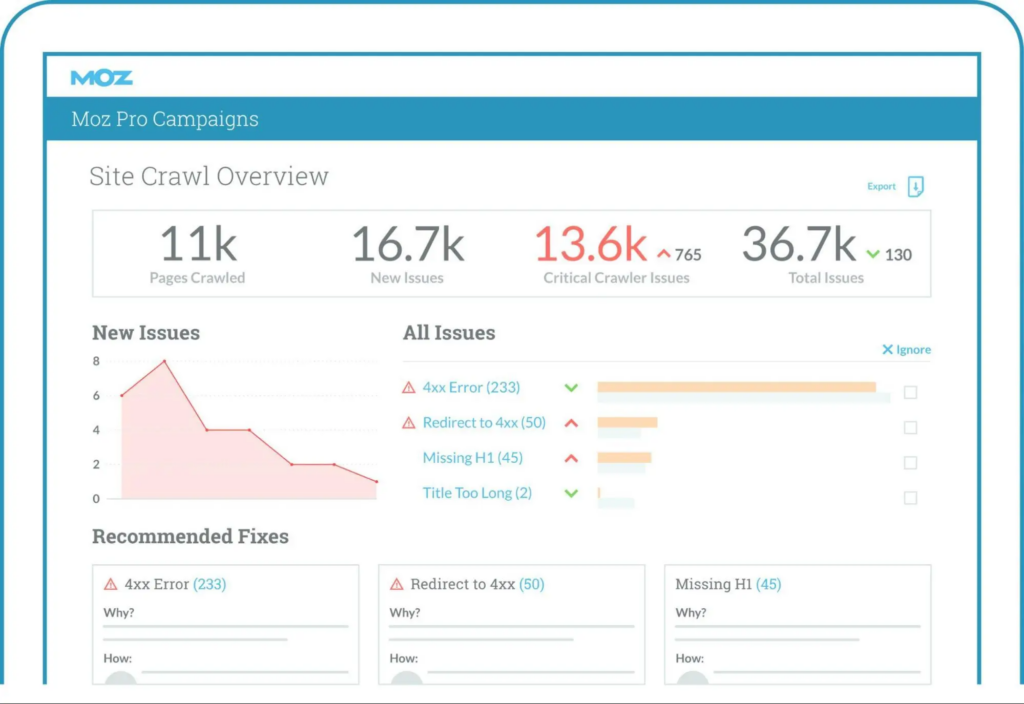

如果你正在寻找更全面的解决方案,可以试试 Moz Site Crawl。虽然 Horseman 侧重于元数据优化和关键词提取,但 Moz 的 Site Crawl 可以识别更广泛的问题,包括重定向、抓取错误和缺失的元数据,并根据其影响对修复进行优先级排序。

他们专有的 Rogerbot 确保即使是复杂的网站也能进行彻底的审核,从而产生可操作的见解,从而更快地解决问题。

- Numerous.ai

Numerous.ai 将 OpenAI 集成到 Google Sheets 中,从而实现批量操作,例如关键词分类、情感分析和内容重写。此工具非常适合大规模执行重复性任务。

Numerous.ai 的主要用例:

- 搜索意图分析: 执行批量关键词分析以识别搜索意图(例如,事务性、信息性、商业性或导航性)。对于较小规模的任务,与 Numerous.ai 集成的 Google Sheets 提供了一个快速且易于访问的解决方案。

但是,像 Moz API 这样的工具对于更大或更关键的工作负载来说是无价的。Moz API 允许你检索其数据库中关键词的最新搜索意图得分,为高风险或企业级项目提供强大的基础。

- 关键词分类: 检测大型关键词列表的父类别或主要主题,从而有效地组织它们。

- 批量内容生成: 同时为多个页面生成标题、元描述、H1 和常见问题解答。

- 模板重写: 重写现有的内容模板,使其对于不同的类别、位置或列表来说是唯一的。

平衡自动化与人类专业知识

自动化是一个强大的盟友,但它并非万无一失。LLM 擅长简化工作流程和生成见解,但保持人工监督对于确保准确性、伦理道德以及与你的品牌指南保持一致至关重要。

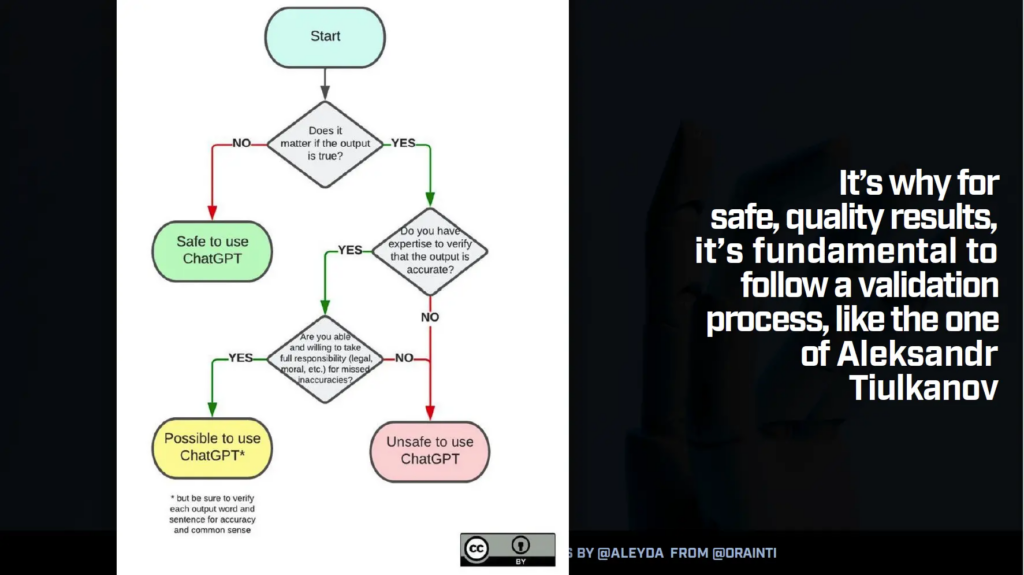

一个验证过程对于实现高质量的结果至关重要。正如 Aleksandr Tiulkanov 强调的那样,专家验证和改进是将人工智能输出转化为可靠、可操作结果的关键。

例如,虽然 LLM 可以批量生成元数据或常见问题解答,但人工审核可确保相关性、独特性以及与 SEO 最佳实践的一致性。我喜欢把 LLM 想象成合作伙伴——它们负责繁重的工作,而我指导最终结果。

以下是如何在自动化和人工输入之间取得适当平衡的方法:

- 审查输出是否与品牌一致: 虽然 LLM 可以快速生成内容,但它们缺乏完全捕捉你的品牌声音的细微差别。始终验证输出是否与你的信息传递一致,并能引起你的受众的共鸣。

- 监控伦理问题和偏见: LLM 缺乏背景,可能会无意中产生带有偏见或文化不敏感的内容。人工审核可以维护包容性并保持道德标准。

- 改进质量和特异性: LLM 的输出可能宽泛或通用。改进它们可以确保最终产品满足用户期望和质量基准。

- 事实核查: 人工智能可能会生成过时或不正确的信息。验证事实可以确保准确性。

- 避免诸如剽窃之类的陷阱: LLM 的输出基于训练数据中的模式,这可能导致重复内容。为了保持质量,使用工具检查原创性并改进结果。

结束语:你需要一个彻底的验证过程,LLM 才能全面发挥作用

像 ChatGPT 这样的人工智能工具可以改变你的 SEO 工作流程——但前提是它们与人类专业知识和强大的验证过程相结合。尝试本文分享的模板、资源和提示库,并探索其他工具来改进你的 SEO 策略。